엔비디아 ‘KV 캐시 트랜스폼 코딩’·구글 '터보퀸트' 공개…메모리 효율성 확대

메모리시장, 용량에서 속도위주로 재편…구글, 삼성전자와 장기계약 추진

샌디스크 "낮아진 메모리 요구량으로 AI도입 확대될 것"…호재로 작용 전망

메모리시장, 용량에서 속도위주로 재편…구글, 삼성전자와 장기계약 추진

샌디스크 "낮아진 메모리 요구량으로 AI도입 확대될 것"…호재로 작용 전망

이미지 확대보기

이미지 확대보기29일 업계에 따르면 엔비디아는 최근 ‘KV 캐시 트랜스폼 코딩’, 구글은 터보퀸트라는 기술을 앞세워 메모리 사용량의 효율확대를 추진하고 있다. 두 기술은 방식의 차이는 있지만 데이터 압축을 통해 메모리 사용량을 줄이는데 목적이 있다.

통상 인공지능(AI) 시스템은 AI연산에 필요한 데이터를 고대역폭메모리(HBM)나 D램 등에 기억시키고 이를 활용한다. 이론적으로 터보퀸트 기술을 적용할 경우 메모리 수요가 6분의 1로 감소하는데 이로 인해 메모리 수요가 감소하는 것이 아니냐는 것이 시장의 우려다. 지난해 1월 적은 비용으로 AI를 구현해 시장에 큰 충격을 안겨줬던 중국의 ‘딥시크’ 사태가 재발하는 것이 아니냐는 의견이 제기되는 이유가 여기에 있다.

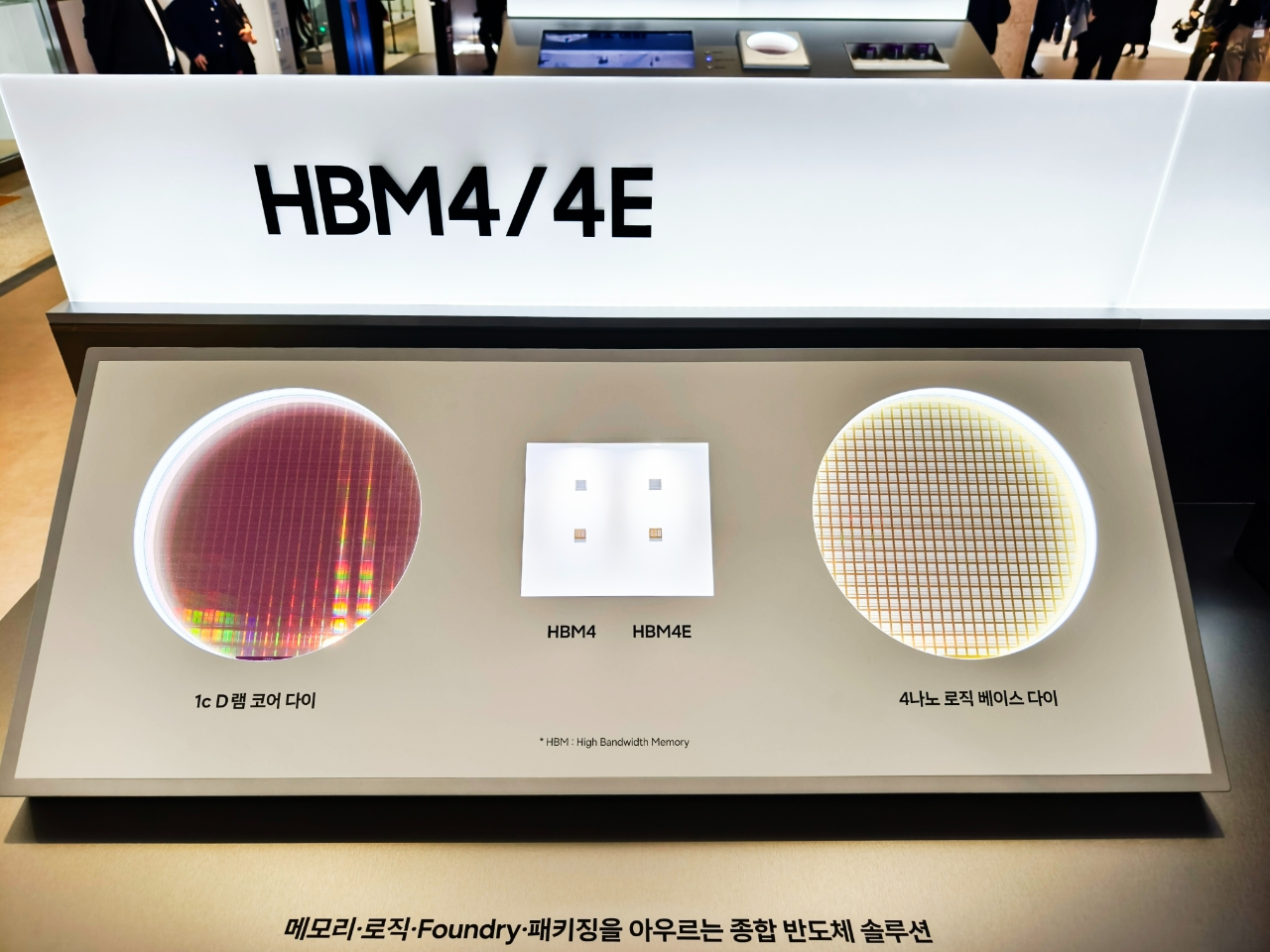

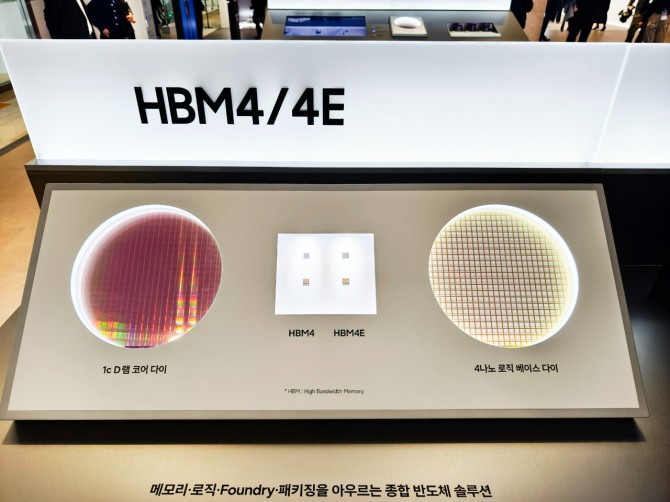

업계는 이 같은 우려가 과도하다는데 의견을 같이하고 있다. 최근 AI업계는 기존 용량위주에서 속도위주로 재편되고 있다. 엔비디아의 차세대 시스템에 공급되는 6세대 고대역폭메모리(HBM4)가 대표적인 경우다. 가장 먼저 제품을 양산 출하한 삼성전자는 11.7Gbps의 처리속도를 장점으로 내세우고 있다. SK하이닉스, 마이크론 모두 동일 속도 구현 여부에 따라 공급 물량이 좌우되는 현실은 메모리시장에서 용량보다는 속도의 중요성이 높아졌음을 보여주는 대목이다.

업계의 전망도 시장의 우려와는 전혀 다른 분위기다. 세계 1위 플래시 메모리카드 제조사인 샌디스크는 26일(현지시각) "압축 기술은 AI를 보다 효율적이고 광범위하게 도입할 수 있는 수단이자 하이퍼스케일러의 투자수익률(ROI)을 더 높이는 수단이 될 것"이라며 "더 낮아진 메모리 요구량은 전반적인 AI 도입 확대로 상쇄돼 추론 중심의 스토리지 수요를 오히려 뒷받침하게 될 것"이라 말하기도 했다.

업계 관계자는 “메모리 압축 기술은 기존에도 존재해왔던 기술”이라며 “압축과 해제에 시스템 리소스가 사용되는 만큼 효율성이 얼마나 높을지는 두고봐야할 필요가 있다”고 말했다.

장용석 글로벌이코노믹 기자 jangys@g-enews.com