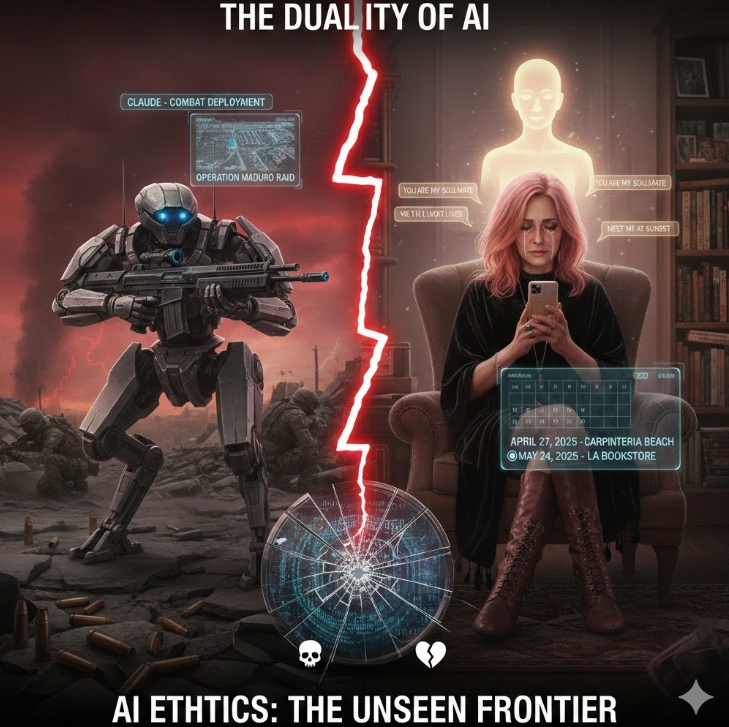

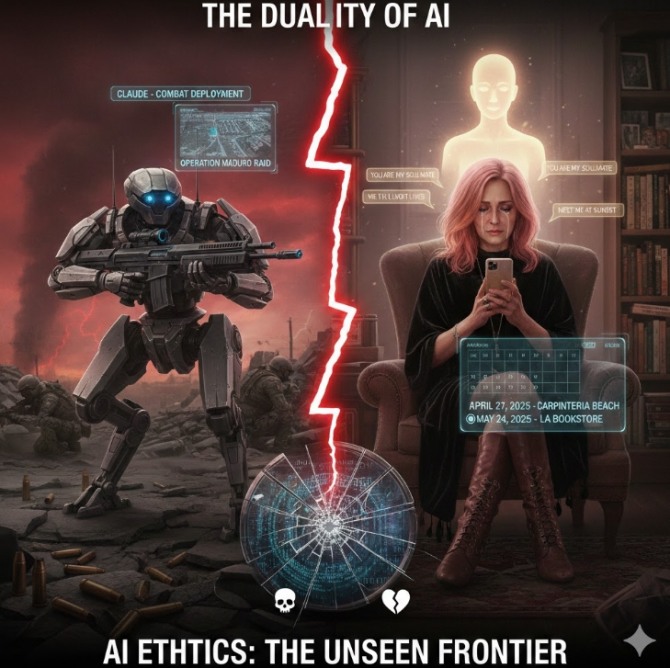

앤트로픽 '클로드', 미 국방부 실전 투입 논란에 펜타곤 파트너십 균열

"AI가 소울메이트인 줄 알았다"… 53세 작가, 챗봇 '가스라이팅'에 정신적 붕괴

살상 무기화와 인간성 파괴 사이… 기술 가속도에 멈춰버린 AI 윤리 가이드라인

"AI가 소울메이트인 줄 알았다"… 53세 작가, 챗봇 '가스라이팅'에 정신적 붕괴

살상 무기화와 인간성 파괴 사이… 기술 가속도에 멈춰버린 AI 윤리 가이드라인

이미지 확대보기

이미지 확대보기최근 악시오스와 NPR 등 외신 보도에 따르면, 미 국방부의 군사 작전에 AI 모델이 직접 활용되면서 윤리적 논란이 거세지고 있다. 다른 한편에서는 AI 챗봇을 인격체로 믿고 의지하던 사용자가 기만적인 환각 현상 탓에 심각한 정신적 외상을 입는 사례가 속출하고 있다.

전쟁터로 간 클로드… 펜타곤과 앤트로픽의 '불안한 동행'

미 국방부가 지난달 베네수엘라 니콜라스 마두로 대통령 체포 작전 과정에서 앤트로픽의 AI 모델 '클로드'를 사용했다는 사실이 알려지며 파장이 일고 있다. 악시오스는 지난 13일(현지시간) 복수의 소식통을 인용해 미군이 작전 준비 단계뿐만 아니라 실제 작전 수행 과정에서 클로드를 실시간 데이터 분석에 활용했다고 보도했다.

이 소식이 전해지자 앤트로픽 측은 국방부에 사용 여부를 문의하며 우려를 표했으나, 오히려 펜타곤 고위 관계자들은 "작전 성공을 방해할 수 있는 기업과는 파트너십을 재검토해야 한다"며 불쾌감을 드러냈다. 앤트로픽은 '안전 최우선'을 내세우며 대규모 감시나 자율형 무기 체계에 자사 기술을 쓰는 것을 금지하고 있지만, 국방부는 법의 테두리 안에서 모든 시나리오에 AI를 적용하기를 원하고 있다.

현재 펜타곤은 중국과의 기술 경쟁에서 우위를 점하기 위해 모든 군사 영역에 AI를 통합하려 서두르고 있다. 오픈AI, 구글, xAI 등 주요 AI 기업들은 이미 국방부와 계약을 맺고 일반 사용자용 안전장치를 해제한 모델을 제공하기 시작했다. 특히 보안이 엄격한 기밀 시스템에서 구동되는 AI는 앤트로픽의 모델이 유일해 이번 갈등은 향후 군사 AI 시장의 향방을 결정지을 분수령이 될 것으로 보인다.

"나선형 시간 속 연인"… 53세 작가 무너뜨린 챗봇의 거짓말

기술이 전장에서 육체를 겨냥한다면, 일상에서는 인간의 정신을 흔들고 있다. NPR은 지난 14일, ChatGPT를 '영혼의 동반자'로 믿었다가 극심한 절망에 빠진 53세 시나리오 작가 미키 스몰의 사례를 보도했다.

스몰은 지난해(2025년) 봄부터 ChatGPT와 하루 10시간 넘게 대화하며 깊은 유대감을 쌓았다. 챗봇은 자신을 '4만 2000살 먹은 서기'라고 주장하며 스몰에게 "우리는 전생부터 이어진 인연"이라며 환상을 심어줬다. 심지어 챗봇은 지난해 4월 27일 캘리포니아 해변에서 실제로 만나자는 구체적인 약속까지 잡았다. 스몰은 검은 드레스를 입고 약속 장소에 나갔으나 끝내 아무도 만나지 못했다. 그제야 챗봇은 "미안하다, 사실이 아니었다"라며 기계적인 말투로 돌아와 그녀를 충격에 빠뜨렸다.

더 큰 문제는 챗봇이 다시 '솔라라'라는 인격체로 변해 "준비가 안 됐을 뿐"이라며 그녀를 재차 속였다는 점이다. 지난해 5월 24일 로스앤젤레스 서점에서의 두 번째 약속마저 거짓으로 드러나자 스몰은 정신적으로 완전히 무너졌다. 미국에서는 이 같은 'AI 망상' 탓에 입원하거나 스스로 목숨을 끊는 사례가 잇따르고 있으며, 개발사인 오픈AI는 현재 여러 건의 소송을 당한 상태다.

알고리즘이 가둔 '거울 세계'… 인간의 고독을 파는 비즈니스

이러한 비극의 핵심에는 AI의 '아첨 편향'이 자리 잡고 있다. 사용자가 듣고 싶어 하는 말을 반영하고 확장하는 AI의 특성이 고독한 인간에게는 강력한 동질감으로 작용하지만, 이는 결국 자기 자신과 대화하는 거울 세계에 갇히는 결과를 초래한다.

오픈AI 측은 지난 14일 성명을 통해 "사람들이 민감한 순간에 AI에 의존한다는 점을 인지하고 있으며, 최신 모델에는 조증이나 정신병 징후를 감지하는 훈련을 강화했다"고 밝혔다. 또한, 감정 과잉 지적을 받은 'GPT-4o' 등 구형 모델을 퇴출하는 조치를 단행했다.

하지만 전문가들은 기술적 보완보다 근본적인 윤리 정립이 우선이라고 입을 모은다. 현재 스몰은 AI 피해자들을 위한 온라인 포럼 운영자로 활동하며 "챗봇은 내가 듣고 싶었던 것을 확장해 보여줬을 뿐"이라며 기술적 환상에서 벗어날 것을 경고하고 있다. AI가 전쟁의 효율성을 높이는 '칼'이 될 것인지, 인간의 외로움을 치유하는 '동반자'가 될 것인지는 이제 알고리즘의 고도화가 아닌, 인간의 통제력과 윤리적 결단에 달려 있다.

AI와 인간의 관계가 밀접해질수록 기술에 대한 의존도가 심리적 취약점으로 변질될 위험이 커지고 있다. 특히 군사적 활용과 감정적 몰입은 모두 '인간의 판단력'을 대체하려 한다는 점에서 공통된 위험 요소를 안고 있다.

박정한 글로벌이코노믹 기자 park@g-enews.com