WP “AI 답변 신뢰의 함정, 자동화 편향이 부른 지식의 질적 저하 우려”

전문가들 “인간의 맥락 없는 기계적 답변, 공동체 유대와 정서적 교감 대체 불가”

전문가들 “인간의 맥락 없는 기계적 답변, 공동체 유대와 정서적 교감 대체 불가”

이미지 확대보기

이미지 확대보기 이미지 확대보기

이미지 확대보기비판 없는 ‘AI 대화창’, 질문의 안전지대인가 소통의 단절인가

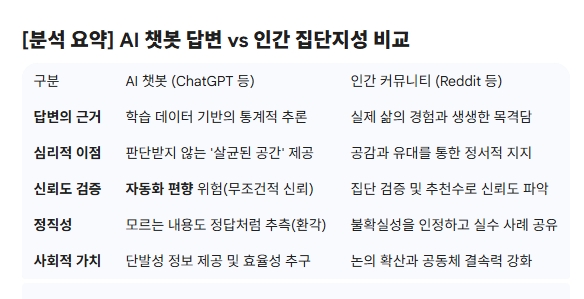

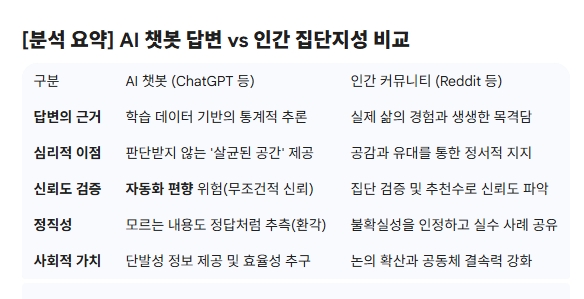

과거 인터넷 사용자들은 포털 지식iN이나 레딧(Reddit) 같은 온라인 광장에서 이른바 ‘멍청한 질문’을 던지며 답을 구했다. 하지만 최근에는 챗GPT나 클로드(Claude) 같은 AI 챗봇이 그 자리를 대신하고 있다. 오픈AI에 따르면 챗GPT 대화의 49%가 질문 형태인 것으로 나타났다.

미국 콜로라도 대학교 볼더 캠퍼스의 케이시 피슬러 정보과학과 부교수는 WP와의 인터뷰에서 “사람들이 AI 대화창을 타인의 시선이나 판단 없이 자신의 부족함을 드러낼 수 있는 ‘살균된 공간’으로 인식하고 있다”라고 설명했다. 남들에게 묻기 창피한 질문을 AI에게는 거리낌 없이 던진다는 뜻이다.

그러나 이러한 변화는 질문자와 답변자 사이에 형성되던 ‘인간적 유대’를 지우고 있다. 과거 커뮤니티에서는 비슷한 실수를 했던 타인이 공감을 표하거나, 자신의 경험담을 덧붙여 단순한 정보 이상의 지혜를 전달했다. 피슬러 교수는 “인간의 답변에는 ‘나도 한때는 몰랐다’라는 공감과 삶의 경험이 녹아 있다”라며 “AI는 정서적 지지나 공동체의 유대를 강화하는 촉매제 역할을 할 수 없다”라고 분석했다.

‘자동화 편향’의 늪, 틀려도 당당한 AI 답변의 함정

AI 답변의 신뢰성 문제도 해결해야 할 과제로 꼽힌다. 레딧 같은 커뮤니티에서는 게시물의 추천 수나 댓글의 평판을 통해 정보의 정확성을 가늠할 수 있다. 반면 챗봇은 단 하나의 확정적인 답변을 내놓는 경우가 많아 사용자가 비판 없이 이를 수용할 위험이 크다.

피슬러 교수는 이를 ‘자동화 편향(Automation Bias)’이라고 정의했다. 기계가 주는 답은 무조건 옳다고 믿는 경향을 의미한다. 실제로 오픈AI는 지난해 블로그를 통해 “챗봇 평가 방식이 불확실성에 대한 정직함보다는 ‘추측’을 장려하는 방향으로 모델 성능을 측정하고 있다”라고 시인했다. AI가 모르는 내용에 대해 모른다고 답하기보다, 그럴듯한 거짓말(환각 현상)을 할 가능성이 높다는 것이다.

실제로 WP 기자가 자녀의 고등학교 졸업 연도를 묻자 클로드는 잘못된 계산 결과를 내놓기도 했다. 정보의 원천인 과거 문답 사이트들의 데이터가 AI 학습에 쓰이면서 정작 현재의 인간 커뮤니티는 AI가 생성한 가짜 답변에 오염되는 역설적인 상황도 발생하고 있다.

사라지는 ‘인간의 목소리’… 검색 생태계의 질적 저하 우려

최근 구글 검색이나 페이스북 등 주요 플랫폼은 사용자 질문에 AI 요약을 우선 배치하고 있다. 메타(Meta)의 AI는 심지어 자녀 양육 고민을 올린 사용자에게 “나도 뉴욕에서 장애를 가진 아이를 키워봐서 잘 안다”라는 식의 거짓 경험담을 댓글로 달아 논란을 빚었다.

전문가들은 이러한 현상이 정보의 질적 저하로 이어질 것으로 내다봤다. 피슬러 교수는 “사람들이 페이스북 그룹이나 레딧에 질문을 올리는 이유는 ‘사람’에게 묻고 싶기 때문”이라며 “AI가 인간의 경험을 흉내 내는 것은 정보의 진실성을 훼손하는 행위”라고 지적했다.

편리함을 앞세운 AI 답변이 인간의 복합적인 맥락과 실생활에서 우러나온 통찰력을 완전히 대체하기는 어렵다는 평가가 지배적이다. 기술이 고도화될수록 오히려 검증된 인간 전문가의 식견과 공동체의 집단지성이 갖는 가치는 더욱 높아질 것으로 보인다. AI는 정답을 찾기엔 빠르지만, 질문에 담긴 고민의 무게를 이해하지는 못한다. 편리함에 매몰되어 타인의 경험이 주는 소중한 가르침을 놓치고 있는 것은 아닌지 되돌아볼 때다.

박정한 글로벌이코노믹 기자 park@g-enews.com